Quand la rentabilité… explose !

Mai 2004. La conductrice d’une Honda récente décède en Alabama. L’airbag censé la protéger se déclenche et projette des éclats de métal dans son cou. C’est le premier accident d’une longue série. 35 morts plus tard, un scandale mondial emporte l’un des plus grands équipementiers japonais, Takata. Mais en 2004, personne ne parle encore de crise. Officiellement, tout va bien. Takata livre des millions d’airbags aux plus grands constructeurs mondiaux, de Honda à Toyota en passant par Ford et General Motors. L’entreprise japonaise incarne la fiabilité et l’excellence.

Mai 2004. La conductrice d’une Honda récente décède en Alabama. L’airbag censé la protéger se déclenche et projette des éclats de métal dans son cou. C’est le premier accident d’une longue série. 35 morts plus tard, un scandale mondial emporte l’un des plus grands équipementiers japonais, Takata. Mais en 2004, personne ne parle encore de crise. Officiellement, tout va bien. Takata livre des millions d’airbags aux plus grands constructeurs mondiaux, de Honda à Toyota en passant par Ford et General Motors. L’entreprise japonaise incarne la fiabilité et l’excellence.

Retour arrière. A la fin des années 90, Takata, sous la pression des acheteurs de l’industrie automobile et de la concurrence, décide de passer d’un propulseur à base d’azoture de sodium vers un propulseur à base de nitrate d’ammonium, près de dix fois moins cher !

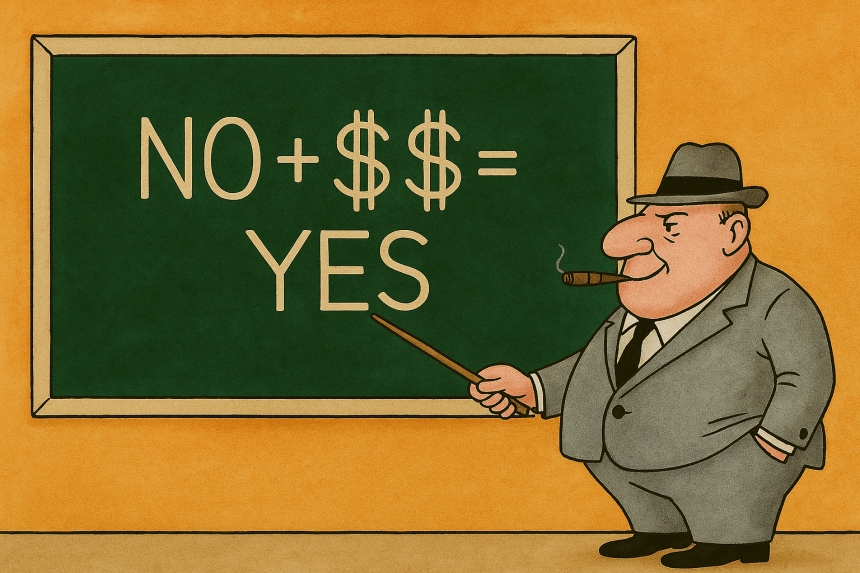

Mais le nitrate d’ammonium est beaucoup plus instable, sensible à la chaleur et à l’humidité. En dépit des tests défectueux dès 2000, et des avertissements écrits des ingénieurs, la Direction décide d’adopter le nitrate d’ammonium. Ce choix lui permet d’abaisser ses prix de revient d’environ 30%, pour le plus grand bonheur de ses financiers et des acheteurs d’Honda, qui représente à l’époque près de 35% de son CA. Takata sacrifie donc la sécurité pour la rentabilité.

A la suite de l’accident de la Honda, les ingénieurs reprennent les tests, alertent à nouveau sur la dangerosité des Airbags, surtout en milieu chaud et humide. Tous les rapports sont minimisés ou reformulés par la Direction pour ne pas compromettre les contrats. Un des témoins, interrogés lors de l’enquête de la NHTSA (agence fédérale américaine de la sécurité routière) dira même : « Un haut dirigeant nous a ordonné que les pièces soient « jetées » et a falsifié le rapport correspondant »

Une version un peu plus stable (2004L) avec un dessicant est mise au point par les ingénieurs de Takata, mais l’entreprise, pour ne pas avoir à modifier ses lignes de production, et pour ne pas reconnaître sa responsabilité dans un produit défectueux, continue de livrer son ancienne version ultra rentable et explique que le 2004L n’est qu’une évolution pour certains pays (mais pas les USA). Takata parle alors « d’incidents isolés »

Takata continue donc à livrer les airbags défectueux, conscients de leur fragilité. L’approche Lean voudrait que l’on arrête la production et que l’on élimine la cause racine (« arrêt au premier défaut »). Mais la Direction de Takata choisit de prolonger l’illusion. Grâce à son produit bon marché, Takata s’adjuge la place de leader mondial. Encore un sou, un dernier petit sou…

Pendant ce temps, les accidents et les morts se multiplient. Les blessés témoignent d’éclats de métal plantés dans le visage ou dans le thorax. Les constructeurs doutent, les autorités s’interrogent, et Takata nie. Le parallèle avec Boeing et le drame du 737 Max est saisissant : là où Boeing, après sa fusion avec McDonnell, a érigé le cours de l’action en indicateur suprême, Takata fait du volume livré et du coût à la pièce sa boussole unique. Pas de retard, pas de rappel, pas de vague. Livrer, toujours livrer davantage. La Voix du Client, la vraie, celle de l’automobiliste, pour qui la sécurité est non négociable, est étouffée au profit de la voix du business.

Il faudra attendre la pression des autorités américaines, pour que l’affaire éclate au grand jour. Plus de 100 millions d’airbags rappelés, la plus vaste campagne de l’histoire automobile. En 2017, Takata dépose le bilan, rachetée par un acteur chinois. Une entreprise majeure (46 000 salariés, 56 usines, 20 pays, avec un CA de 5 Md€), autrefois respectée, disparaît dans le déshonneur. Pour avoir sacrifié la qualité à la rentabilité.

Quand les financiers et les commerciaux dictent la qualité, quand le seul indicateur critique devient le coût unitaire ou la marge trimestrielle, la Voix du Client se dissout dans une feuille Excel. Takata n’est pas une anomalie, mais un cas d’école : la preuve que l’obsession de la rentabilité peut transformer un dispositif de sécurité en arme mortelle. Bien sûr qu’une entreprise doit être rentable, mais sa rentabilité n’a jamais été un moteur pour les collaborateurs ni un objectif pour les clients. Un de mes anciens patrons, président d’un groupe industriel, me disait souvent quand je lui parlais des coûts : « D’abord on sert le client. Ensuite, on améliore la rentabilité »

Alors, la prochaine fois qu’un directeur financier vous explique comme une évidence que « l’ingénierie doit s’aligner sur les objectifs de rentabilité », demandez-lui s’il monterait dans une voiture équipée d’un airbag Takata ou dans un 737 Max…